X aplica filtro algorítmico a cuentas nacionales cubanas como mecanismo de censura

Tiempo de lectura aprox: 5 minutos, 50 segundos

Cuba es blanco de censura algorítmica desde marzo de 2026, según demuestra una nueva investigación del Observatorio de Medios de Cubadebate. Por la exhaustividad de la investigación, 5 de Septiembre reproduce este material.

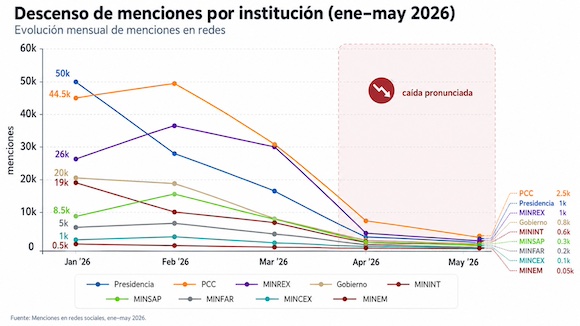

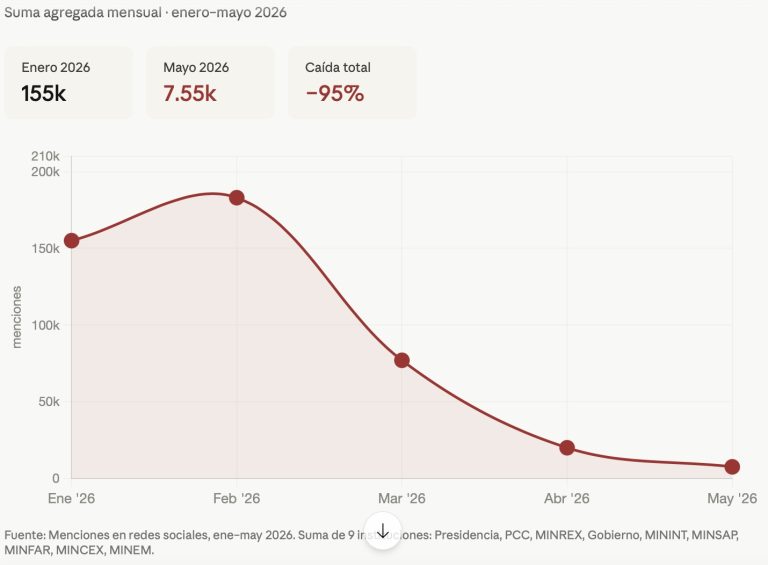

La investigación, basada en el análisis de más de 600 mil menciones en X a cuentas institucionales cubanas entre enero y mayo de 2026, identifica una caída abrupta, transversal y sincronizada del alcance y la conversación digital sobre organismos del Estado cubano.

El estudio vincula este comportamiento con patrones de shadowban y reducción algorítmica de visibilidad ya documentados por investigaciones internacionales durante la guerra en Gaza, donde plataformas como X y Meta fueron acusadas de limitar sistemáticamente contenidos considerados contrarios a los intereses geopolíticos de Washington e Israel.

Durante años, las grandes plataformas digitales se presentaron como espacios neutrales de circulación de información. Twitter/X, Facebook, Instagram o YouTube afirmaron que sus algoritmos solo organizaban contenidos según criterios técnicos de relevancia, interacción o seguridad.

Sin embargo, las investigaciones más recientes sobre la guerra en Gaza han desmontado esa narrativa. Hoy existe abundante evidencia académica, técnica y documental de que las plataformas pueden manipular visibilidad, reducir alcance, penalizar contenidos y alterar artificialmente la circulación de determinadas voces políticas.

El fenómeno tiene un nombre ampliamente utilizado por usuarios, investigadores y especialistas en plataformas: shadowban. A diferencia de la censura tradicional, el shadowban no elimina necesariamente el contenido. El mensaje sigue existiendo, pero pierde capacidad de circulación. Aparece menos en búsquedas, recomendaciones y tendencias; deja de ser sugerido por el algoritmo; pierde alcance orgánico y termina desapareciendo progresivamente del espacio público digital.

En el caso palestino, múltiples investigaciones han demostrado cómo contenidos vinculados con Gaza, denuncias sobre bombardeos israelíes y publicaciones de periodistas o activistas propalestinos fueron sometidos a restricciones algorítmicas, bloqueos, desmonetización, eliminación de hashtags y campañas coordinadas de reportes. Lo relevante es que estas prácticas no aparecieron como errores aislados, sino como patrones sistemáticos dentro de un contexto geopolítico específico.

La hipótesis que emerge de esta investigación sobre Cuba es inquietante: las mismas dinámicas de silenciamiento algorítmico observadas durante el genocidio en Gaza podrían estar siendo utilizadas para reducir la capacidad de comunicación pública de Cuba en un momento de creciente escalada política, mediática y estratégica impulsada desde Estados Unidos.

Investigaciones sobre Gaza

La guerra en Gaza se convirtió en uno de los principales laboratorios contemporáneos para estudiar cómo funcionan la moderación algorítmica, la censura digital y las operaciones de invisibilización en redes sociales.

Uno de los estudios más importantes, Silencing & Surging: A Layered Ecology of Algorithmic Repression and Resistance in the Gaza Escalations, elaborado por investigadores de universidades de Canadá, Alemania, Reino Unido y Estados Unidos y publicado en abril de 2026, documentó cómo periodistas, activistas y usuarios palestinos sufrían sistemáticamente: reducción de alcance; eliminación de publicaciones; suspensión de cuentas; bloqueo de hashtags; desindexación; y penalizaciones algorítmicas. La investigación trabajó con 295 testimonios directos; 85 documentos de ONG y medios; y análisis de comportamiento de plataformas entre octubre de 2023 y agosto de 2025.

Los autores identificaron un mecanismo recurrente que denominaron Contest Loop: brigadas organizadas reportaban contenidos palestinos, los sistemas automáticos reducían o eliminaban publicaciones y posteriormente las comunidades intentaban recuperar visibilidad mediante apelaciones, cuentas espejo o migración hacia otras plataformas.

El estudio concluye que el shadowban opera como una forma de “estrangulamiento probabilístico”: el contenido no desaparece completamente, pero queda sofocado dentro de la arquitectura algorítmica.

Otra investigación clave, Who Should Set the Standards?, de abril de 2025, analizó 448 publicaciones en árabe eliminadas por Facebook durante el conflicto palestino-israelí. Los investigadores encontraron una diferencia significativa entre cómo los usuarios árabes interpretaban las normas comunitarias y cómo Facebook aplicaba realmente esas reglas. El estudio concluye que las plataformas globales incorporan sesgos culturales y geopolíticos que afectan especialmente a comunidades consideradas periféricas o políticamente incómodas para Occidente.

A esto se suma el trabajo Algorithmic Arbitrariness in Content Moderation, de febrero de 2024, realizado por investigadores de Harvard y Oxford. Demostró que los sistemas automáticos de moderación producen decisiones arbitrarias incluso usando modelos técnicamente equivalentes. En algunos casos, alrededor del 30 % de las decisiones podían cambiar simplemente modificando variables menores del sistema.

Los autores advierten que esta arbitrariedad permite restringir discursos políticos sin necesidad de órdenes explícitas de censura. El algoritmo se convierte así en un mecanismo opaco de gestión de la visibilidad pública.

En paralelo, estudios sobre propaganda digital israelí y guerra algorítmica en Gaza mostraron cómo las plataformas funcionan como infraestructuras políticas activas. El artículo Digital Illusions, Political Delusions sostiene que la Hasbara, estrategia de comunicación y diplomacia pública internacional del Estado de Israel, evolucionó hacia una sofisticada estructura digital integrada con redes sociales y sistemas de amplificación algorítmica.

El resultado general de estas investigaciones es contundente: las plataformas no son espacios neutrales. Organizan jerarquías de visibilidad, favorecen determinados marcos políticos y pueden actuar como infraestructuras de silenciamiento durante conflictos geopolíticos.

Hallazgos de la investigación sobre Cuba

A partir del monitoreo de las cuentas institucionales cubanas en X entre el 1 de enero y el 13 de mayo de 2026, se analizaron más de 600 mil menciones vinculadas con:

@partidopcc

@cubaminrex

@presidenciacuba

@minfarc

@minint_cuba

@MINSAPCuba

@gobiernocuba

@cubamined

@mincex_cuba

@energiaminascub

Los datos revelan un patrón altamente anómalo.

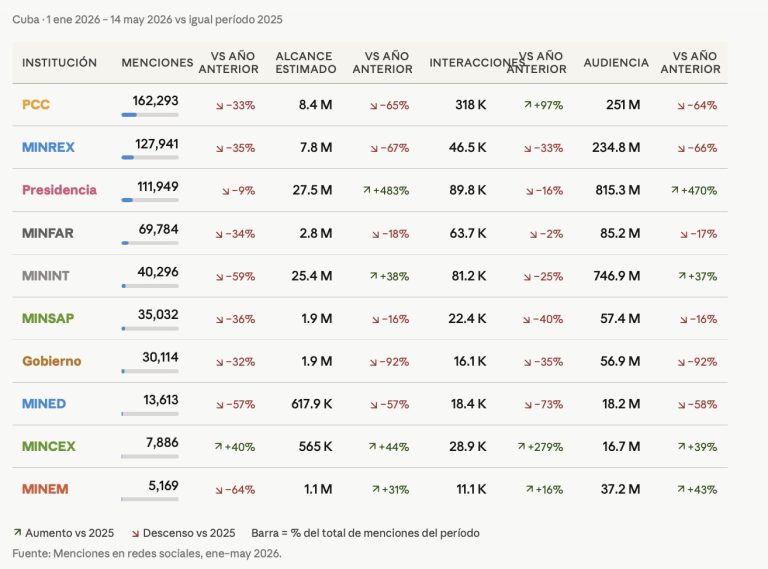

Las cuentas muestran una caída generalizada y simultánea de menciones, alcance y audiencia digital respecto al mismo período del año anterior:

PCC: -33 % en menciones;

MINREX: -35 %;

MINFAR: -34 %;

MININT: -59 %;

MINSAP: -36 %;

Gobierno: -32 %;

MINED: -57 %;

MINEM: -64 %.

La curva temporal es aún más reveladora. Entre enero y marzo existía todavía un volumen relativamente elevado de conversación digital. Sin embargo, a partir de abril se produce un derrumbe abrupto y sincronizado que afecta prácticamente a todas las instituciones analizadas.

La caída ocurre además en un contexto político específico: incremento de amenazas desde Washington; escalada discursiva de Donald Trump y Marco Rubio; aumento de operaciones mediáticas sobre Cuba; incremento de vigilancia militar y narrativa de “crisis terminal” sobre la Isla.

En términos técnicos, el patrón observado es compatible con procesos de:

reducción algorítmica de distribución;

pérdida de indexación;

despriorización en recomendaciones;

disminución artificial del alcance orgánico.

El comportamiento resulta especialmente llamativo porque no afecta únicamente a una cuenta concreta o a un tema específico, sino a organismos de naturaleza muy distinta:

diplomáticos;

militares;

salud;

económicos;

educativos;

gubernamentales.

Eso reduce significativamente la posibilidad de una explicación puramente orgánica basada en desinterés espontáneo de las audiencias. En condiciones normales, un escenario de alta tensión geopolítica suele aumentar la conversación pública, no reducirla abruptamente en un 95 %. El patrón observado se asemeja más a procesos de despriorización algorítmica o restricción artificial de circulación que a una pérdida espontánea de audiencias.

Algunos patrones que destacan en la comparativa con el año anterior:

La gran mayoría de las instituciones registran caídas generalizadas en menciones y alcance, con excepciones notables: Presidencia incrementa de forma excepcional su alcance (+483%) y audiencia (+470%), y MINCEX crece en todas sus métricas, incluyendo un notable +279% en interacciones. MININT también sube en alcance y audiencia pese a perder menciones, lo que sugiere que cuando se le menciona, el contenido llega más lejos.

En el extremo opuesto, MINED (−73% en interacciones) y MINEM (−64% en menciones) acumulan las caídas más pronunciadas en prácticamente todas las dimensiones.

El comportamiento temporal muestra que prácticamente todas las cuentas institucionales —con excepción de MINED y MINEM, que ya venían mostrando debilidad relativa— mantuvieron crecimiento, estabilidad o niveles elevados de conversación hasta marzo de 2026. Incluso organismos con descensos interanuales acumulados conservaban volúmenes relevantes de menciones, alcance e interacción durante el primer trimestre.

El colapso aparece de forma abrupta y sincronizada a partir de abril. Ese quiebre común en el comportamiento resulta difícil de explicar mediante dinámicas orgánicas independientes.

Al mismo tiempo, algunos indicadores muestran una paradoja típica de los procesos de shadowban: determinadas cuentas mantienen niveles relativamente altos de interacción proporcional entre quienes todavía logran ver los contenidos, mientras el alcance total y la audiencia potencial se desploman.

Presidencia y MININT, por ejemplo, aumentan fuertemente audiencia estimada y alcance agregado por episodios concretos de alta viralidad, pero simultáneamente pierden volumen general de conversación y capacidad sostenida de circulación pública.

Esto coincide con lo observado en Gaza: las plataformas permiten ocasionalmente ciertos picos visibles, mientras degradan silenciosamente la circulación estructural cotidiana.

Conclusiones

La evidencia disponible permite sostener que existen patrones compatibles con dinámicas de silenciamiento algorítmico ya documentadas en otros escenarios geopolíticos, particularmente en Gaza.

Las investigaciones internacionales revisadas demuestran que:

las plataformas manipulan visibilidad;

los algoritmos no son neutrales;

la moderación automática incorpora sesgos políticos y culturales;

determinadas comunidades o actores geopolíticos sufren restricciones desproporcionadas.

El caso cubano muestra señales compatibles con esos mismos mecanismos:

caída sincronizada de visibilidad;

reducción transversal de conversación;

desplome abrupto del alcance orgánico;

pérdida simultánea de audiencia digital en cuentas institucionales estratégicas.

En la guerra contemporánea, la batalla comienza mucho antes de una intervención militar directa y que la información se torna muy opaca. Primero se disputa el encuadre narrativo. Luego se reduce la visibilidad de la víctima potencial. Finalmente se naturaliza el aislamiento político y simbólico del objetivo.

Gaza demostró que las plataformas pueden funcionar como infraestructuras de silenciamiento durante un genocidio. Cuba podría estar enfrentando ahora una fase preliminar de ese mismo modelo: una reducción progresiva de su capacidad de comunicación pública internacional en medio de una creciente escalada estadounidense.

Visitas: 2