El espejismo digital: cuando la inteligencia artificial aprende a mentir con rostro humano

Tiempo de lectura aprox: 3 minutos, 47 segundos

En la era de la posverdad, donde los límites entre lo real y lo ficticio se difuminan con una facilidad alarmante, ha emergido una herramienta capaz de llevar el engaño a un nivel nunca antes visto.

Los deepfakes, producto de la convergencia entre el aprendizaje profundo y la edición audiovisual, permiten crear vídeos, audios e imágenes hiperrealistas en los que una persona parece decir o hacer algo que jamás ocurrió. Lo que comenzó como un experimento académico en laboratorios de inteligencia artificial se ha convertido en un arma de doble filo: por un lado, una innovación técnica fascinante; por el otro, un vehículo perfecto para la desinformación, el fraude y la destrucción de reputaciones.

Los usos y fines de los deepfakes son tan variados como controvertidos. En el terreno lúdico y comercial, la tecnología ha permitido doblar películas preservando los movimientos labiales de los actores, resucitar digitalmente a artistas fallecidos para campañas publicitarias o crear experiencias inmersivas en museos. Sin embargo, el lado oscuro predomina con creces. Grupos malintencionados emplean los deepfakes para fabricar discursos incendiarios de líderes políticos, simular confesiones falsas, generar pornografía no consentida de personas comunes o famosas, y suplantar identidades en videollamadas para estafar a empresas. El salto cualitativo es brutal: antes se falsificaba un documento, hoy se falsifica a la persona misma en movimiento y con voz.

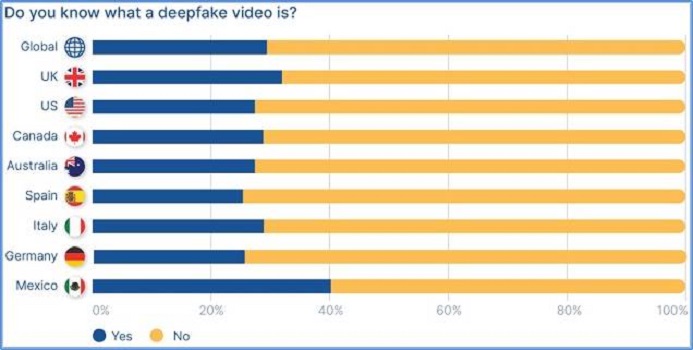

El alcance de este fenómeno es global y crece a una velocidad exponencial. Con la democratización de las herramientas de inteligencia artificial, hoy cualquier usuario con conocimientos básicos puede generar un deepfake mediocre, pero los actores más sofisticados desde servicios de inteligencia rivales hasta ciberdelincuentes organizados producen materiales indistinguibles del ojo humano. Las redes sociales actúan como aceleradores virales: un vídeo falso puede dar la vuelta al mundo en horas, ser replicado por miles de cuentas y generar daños irreversibles antes de que aparezca la primera verificación. La capacidad de desestabilizar una campaña electoral, hundir la bolsa de valores de una empresa o incitar disturbios sociales ya no es hipótesis de ciencia ficción, sino una amenaza activa y documentada.

Las consecuencias para las personas naturales son devastadoras y a menudo invisibles para quien no las padece. Una mujer común puede ver su rostro superpuesto en vídeos pornográficos distribuidos por antiguas parejas o acosadores, sufriendo acoso, pérdida de empleo y traumas psicológicos profundos. Un político o activista puede ser destruido por un audio falso donde pronuncia insultos racistas, con la carga de la prueba invertida: le toca a la víctima demostrar que no dijo eso, algo casi imposible cuando la tecnología es buena. Incluso ciudadanos anónimos han sido extorsionados con deepfakes que los muestran en situaciones comprometedoras, creados sin su consentimiento a partir de fotos públicas de sus redes sociales. El daño reputacional, emocional y económico que sufren estas personas rara vez encuentra reparación efectiva en los sistemas judiciales actuales.

Las instituciones tampoco escapan a esta amenaza. Gobiernos, bancos, medios de comunicación y tribunales ven erosionada su credibilidad cuando cualquier vídeo auténtico puede ser desmentido bajo la sospecha de ser un deepfake. El fenómeno conocido como “mentira de IA” genera un caldo de cultivo perfecto para el cinismo y la desconfianza generalizada: si todo puede ser falso, nada merece fe. Empresas han perdido millones tras videollamadas donde un deepfake del director financiero ordenaba transferencias urgentes. Servicios de inteligencia han difundido deepfakes de mandatarios enemigos para provocar malentendidos diplomáticos. Y en el ámbito judicial, la posibilidad de que una grabación de vigilancia o una declaración en vídeo sean fabricadas amenaza con colapsar la noción misma de prueba audiovisual.

Enfrentar este fenómeno exige una estrategia de múltiples frentes, donde ninguna solución por sí sola es suficiente. En primer lugar, la alfabetización digital ciudadana se vuelve tan prioritaria como la enseñanza de la lectura. La población debe aprender a desconfiar por defecto de vídeos virales no verificados, a buscar fuentes originales y a reconocer ciertos artefactos técnicos —parpadeos irregulares, sombras extrañas, sincronía imperfecta de labios— que aún delatan a los deepfakes menos perfeccionados. Los medios de comunicación tienen la obligación ética de no difundir contenidos dudosos sin un etiquetado claro, y de formar a sus redacciones en técnicas forenses digitales.

Las vías tecnológicas para combatir los deepfakes avanzan con rapidez, aunque siempre por detrás de la generación de falsificaciones. Universidades y empresas desarrollan detectores automáticos basados en redes neuronales entrenadas para identificar patrones invisibles al ojo humano, como irregularidades en el flujo sanguíneo simulado de la piel o incoherencias en los reflejos de los ojos. Otra línea prometedora es la autenticación mediante huella digital desde el origen: cámaras que incrustan metadatos cifrados y marcas de agua en cada vídeo, o blockchain que certifica la cadena de custodia del contenido. Las grandes plataformas (YouTube, Facebook, TikTok) ya han implementado políticas de etiquetado y eliminación de deepfakes maliciosos, pero su aplicación es inconsistente y enfrenta el desafío de distinguir entre parodia, sátira y engaño dañino.

El frente legal y regulatorio es quizás el más rezagado y a la vez el más indispensable. Muy pocos países cuentan con leyes específicas contra la creación y difusión maliciosa de deepfakes. Se necesitan tipificaciones penales que diferencien el uso artístico o crítico del engaño fraudulento, la suplantación no consentida y la pornografía sintética. También deben establecerse obligaciones para las plataformas de eliminar este contenido en plazos perentorios, bajo amenaza de multas sustanciales. A nivel internacional, la cooperación es clave: un deepfake generado en un país con legislación laxa puede dañar a víctimas en otra jurisdicción, y los tratados de asistencia judicial mutua deben adaptarse a esta realidad.

La principal vacuna contra los deepfakes sigue siendo la más simple y la más difícil de implementar: restaurar una cultura de verificación, paciencia y pensamiento crítico. En una época donde la inmediatez digital premia compartir antes que comprobar, frenar el impacto de los deepfakes exige devolverle valor al periodismo lento, a las fuentes primarias, a la cadena de custodia de la evidencia.

No se trata de vivir con miedo a cada píxel, sino de entender que la tecnología ha roto para siempre la confianza ciega en el “ver para creer”. Los deepfakes nos obligan a reconstruir el contrato social de la información: ya nada es creíble solo porque se vea, sino porque múltiples líneas de evidencia lo respaldan. Y esa lección, aunque dolorosa, quizás sea la más valiosa que esta inquietante herramienta pueda dejarnos.

Visitas: 5